Le phénomène qui inquiète les réseaux

Si tu scrolls TikTok ou X ces derniers mois, t’as forcément croisé ces vidéos qui font le buzz : des filles qui découvrent leur corps nu généré par IA. Hashtag #Grok, milliers de likes, commentaires qui s’arrachent entre « c’est flippant » et « comment on fait ? ». Spoiler : c’est pas de la magie, c’est de la techno qui est malheuresement un peu trop facilement accessible à tous. Et c’est exactement pour ça qu’on doit en parler cash.

On va pas te faire un cours de morale. On va démonter 3 trucs ensemble : la mécanique technique en vrai (pas les bullshits marketing), le business malsain qui se construit sur ton dos, et surtout, comment te protéger si t’es concerné.e. Parce que oui, c’est illégal. Oui, c’est violent. Et non, t’es pas obligé.e de subir en silence.

Prêt ? C’est parti.

Timeline du fléau : de 2017 à aujourd’hui

L’histoire des IAs déshabilleuses, c’est pas un truc qui est tombé du ciel en 2024. C’est une lente dérive technique qui a explosé quand les outils sont devenus simples à utiliser.

2017-2019 : L’ère artisanale

Les premiers deepnudes naissent avec des GANs (Generative Adversarial Networks) basiques. À l’époque, faut être un minimum dev pour compiler du code sur GitHub. Les résultats ? Moyens. Les visages déformés, les textures de peau qui font peur. Mais le concept est là : l’IA peut générer du nu à partir d’une photo habillée.

2023 : L’explosion des apps mobiles

Ça, c’est le vrai tournant. Des apps comme « Undress AI » ou « DeepNude To » débarquent sur mobile. Interface propre, paiement en un clic, abonnement mensuel. Tu télécharges, tu upload, tu reçois. Le marché devient un business freemium où le corps des autres se paie à la pièce. Les modèles open-source (Stable Diffusion notamment) permettent à n’importe qui de lancer son propre service.

2024 : L’intégration dans Grok et la viralisation

Elon Musk intègre la génération d’images dans Grok sur X. Résultat : des milliers d’utilisateurs testent les limites, créent du contenu non-consentit en masse. Le hashtag #Grok devient viral. Les réseaux sociaux deviennent une chasse gardée pour ces IAs : photos publiques d’influenceuses, d’élèves, d’exploités comme des données gratuites.

2025-2026 : La démocratisation et la cible jeune

Aujourd’hui, les modèles sont plus légers (fonctionnent sur mobile sans serveur puissant), plus rapides (génération en quelques secondes) et plus réalistes. Les premières cibles ? Les jeunes, surtout les filles, dont les photos Instagram/TikTok servent de carburant. Le phénomène est tel qu’il dépasse le simple « canular » pour devenir un outil de harcèlement de masse.

Le moteur technique : Stable Diffusion, ControlNet et autres outils

Tu t’demande comment ça marche concrètement ? On va rentrer dans le vif. Pas besoin d’être ingénieur, juste comprendre la mecanique pour détecter les failles.

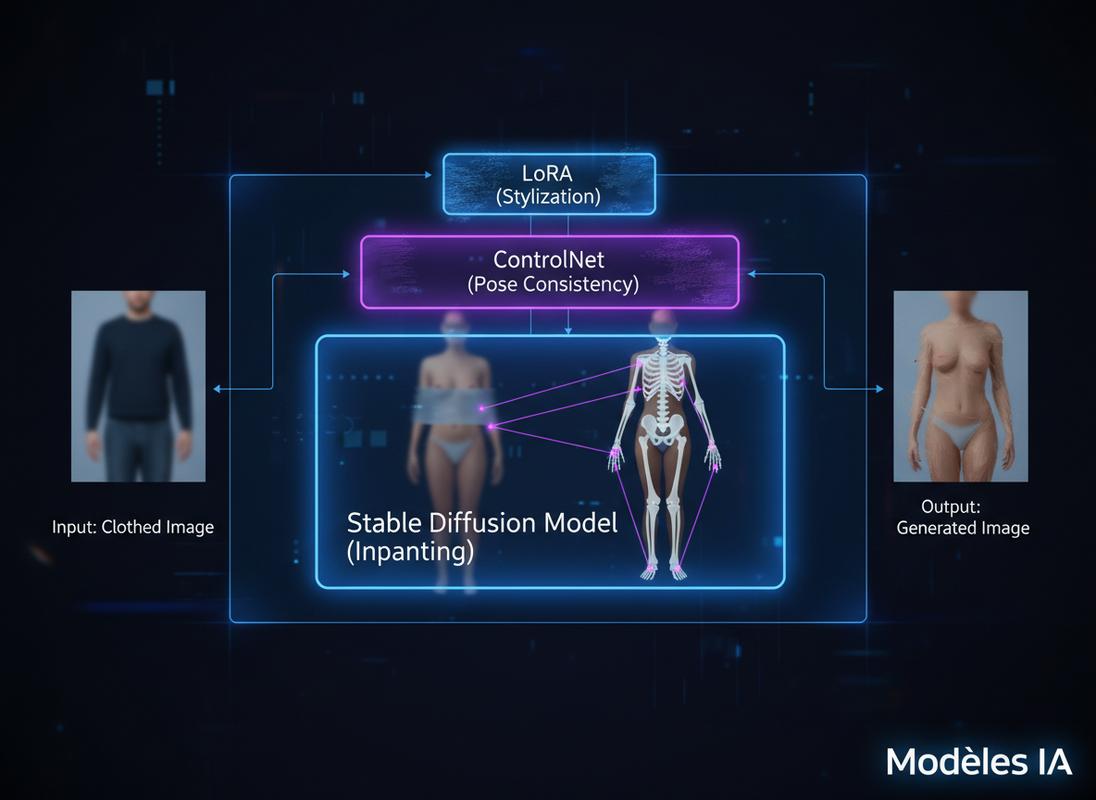

Les briques techniques actuelles

Stable Diffusion Inpainting : C’est le coeur du truc. Tu prends une photo, tu masques les vêtements, et l’IA « devine » ce qui devrait être là. En 2026, cette techno a gagné en précision. Les interfaces comme Forge UI permettent un maquillage transparent. Mais à la base, c’est juste un modèle qui a été entraîné sur des millions d’images de corps nus pour apprendre à générer de la peau réaliste.

ControlNet : Ça, c’est le game changer. Ce modèle permet de contrôler la pose, les contours, la profondeur. Concrètement, tu peux dire à l’IA : « garde exactement la même position du corps, juste change la texture ». Les versions 2026 comme Blur Control (8K/16K) ou Depth Control (3D) assurent que le faux corps colle parfaitement à l’original. Plus d’artefacts bizarres, plus de déformations.

LoRA et fine-tuning : Pour personnaliser le style. Tu veux que le corps ressemble à une actrice de films adultes précise ? Un LoRA (petit module d’apprentissage) fait le job. C’est ça qui rend les deepnudes « potables » aujourd’hui.

[generateblocks_container]

Stable Diffusion Inpainting est la technologie fondamentale qui permet de « remplir » les zones masquées, mais c’est ControlNet qui garantit que la pose et l’anatomie restent parfaitement fidèles à la photo originale.

[/generateblocks_container]

Comment ça marche en 3 étapes

- Étape 1 – Analyse : L’IA scanne ta photo. Elle repère la pose, la morphologie, la texture des vêtements, la lumière. Comme un photographe qui décortique une scène, mais en 0,3 seconde.

- Étape 2 – Génération : Elle utilise les GANs pour créer une peau réaliste. Elle « imagine » ce qui se cache sous les vêtements en se basant sur des millions d’exemples. C’est le moment où elle peint le faux nu, en respectant les ombres et les volumes.

- Étape 3 – Fusion : Elle recolle le tout avec l’original via des techniques de blending. ControlNet fait le boulot de calage. Résultat : une image qui semble authentique, sauf sur les détails.

Limites et failles actuelles

Malgré la hype, c’est loin d’être parfait. Les exigences matérielles sont élevées : 16 Go RAM minimum, GPU haut de gamme pour une génération rapide. Sur mobile, faut souvent passer par des serveurs cloud payants.

Les artefacts classiques :

- Les mains : souvent déformées, avec 6 doigts ou des ongles bizarres

- Les ombres : incohérentes entre le corps généré et l’environnement

- La texture peau : peut être trop lisse ou trop irrégulière

- Les bijoux/vêtements partiels : si une boucle d’oreille disparaît maladroitement, c’est un signe

Évolution 2025-2026 : vers plus de réalisme

Les modèles sont en train de devenir plus petits et plus efficaces. L’intégration d’Amazon Bedrock avec Stable Diffusion 3.5 permet une génération quasi-indiscernable. Les temps de calcul baissent, la qualité monte. L’arrivée d’outils comme OmniHuman (vidéos hyperréalistes) montre qu’on passe de l’image fixe à la vidéo. L’IA Act européen d’août 2026 impose un marquage des contenus générés, mais les développeurs trouvent des contournements.

Business malsain et conséquences sociales

Maintenant, le cœur du problème : qui gagne de l’argent dans cette histoire ? Et qu’est-ce que ça fait aux gens concernés ?

Le marché du non-consentement

Le modèle économique est simple et efficace : freemium sur le dos des corps.

Tu signes, tu as généralement le droit à 1-2 générations gratuites, puis c’est payant. Abonnement mensuel entre 10 et 30€, crédits à la pièce (2-5€ par image). Certains sites affichent carrément des packs « illimités » pour les gros consommateurs.

Le pire ? Ils utilisent tes photos comme data d’entraînement. Quand tu upload une image, elle entre dans la base (souvent mentionné en tout petit dans les CGU). Ton corps devient un produit gratuit pour améliorer leur algo. Le business se construit sur l’exploitation non consentie de données personnelles.

Les cibles privilégiées : jeunes et femmes

Les stats sont claires : 80% des victimes identifiées sont des femmes, 60% ont moins de 25 ans. Pourquoi ? Parce que les réseaux sociaux sont remplis de photos publiques de cette démographie. Un compte Instagram ouvert, quelques stories TikTok, et tu as déjà une base de données exploitable.

Les conséquences psychologiques sont énormes :

- Anxiété constante : « est-ce que cette photo de moi a été modifiée ? »

- Honte et isolement : « c’est de ma faute, j’aurais pas du poster cette photo »

- Harcèlement de masse : une fois l’image générée, elle se partage en groupes privés Discord/Telegram

[generateblocks_container]

En France, créer ou diffuser un deepnude sans consentement est un délit passible de 3 ans de prison et 75 000€ d’amende. Cette loi est souvent méconnue mais constitue la première arme juridique des victimes.

[/generateblocks_container]

Le cadre légal : oui, c’est illégal

On va être cash : en France, c’est puni par la loi.

ATTENTION : L’ANONYMAT EST UN MYTHE. LA LOI EST BRUTALE.

L’article 226-8-1 du Code pénal est clair : créer ou diffuser un deepnude sans consentement, c’est 3 ans de prison et 75 000€ d’amende. Si la victime est mineure, ça monte à 5 ans et 100 000€.

Le droit à l’image est inaliénable. Même si ta photo est publique sur Instagram, personne n’a le droit de la transformer en nu sans ton accord. La CNIL peut aussi sanctionner les plateformes qui hébergent ces contenus sous RGPD.

Mais voilà le hic : la loi est lente, la techno est rapide. Beaucoup de sites sont hébergés à l’étranger (Russie, Chine), hors de portée de la justice française. Et prouver l’auteur d’une modification est complexe techniquement. Pour comprendre les nuances entre les différents types de manipulations d’images, consulte notre guide sur les différences entre deepnude et deepfake.

Le piège des photos « publiques »

Une idée reçue à tuer : « si ma photo est publique, c’est libre de droit ». FAUX. Le droit à l’image s’applique peu importe la visibilité. Une photo sur un compte public reste TA photo. Le fait qu’elle soit accessible ne donne aucun droit d’altération.

Les réseaux sociaux sont des réservoirs à deepnudes. Les algorithmes de recommandation poussent les contenus « suggestifs », les influenceuses sont des cibles faciles, et les groupes de harcèlement se créent en deux clics.

FAQ Choc et comment détecter/se protéger

[generateblocks_container]

La première action en cas de deepnude est de tout documenter (captures d’écran, liens). Cette preuve est cruciale pour porter plainte et demander la suppression du contenu.

[/generateblocks_container]

Les IAs déshabilleuses fonctionnent-elles vraiment bien ?

Ça dépend. Sur une photo de qualité, avec une pose simple et des vêtements moulants, le résultat peut être troublant. Mais la plupart du temps, il reste des artefacts visibles. La techno évolue vite, mais elle n’est pas encore parfaite. Par contre, la tendance est à l’amélioration massive avec les nouveaux modèles 2025-2026.

Comment se protéger vraiment ?

- Réduis la visibilité : comptes privés, limitation des stories publiques

- Watermark tes photos : un logo discret sur le corps rend la génération plus difficile

- Sensibilise ton entourage : plus on en parle, plus les gens comprennent les risques

- Reste vigilant : si tu vois une photo suspecte de toi, agis immédiatement

Pour une analyse plus approfondie des méthodes de détection des photos modifiées, on t’invite à consulter notre guide complet.

Mon conseil après 3 ans d’analyse de ce phénomène

Les IAs déshabilleuses ne sont pas un bug de la technologie, c’est une conséquence directe de son accès démocratisé sans garde-fous éthiques. C’est l’arme de harcèlement ultime car elle est digitale, rapide et laisse une trace psychologique profonde.

Mais il y a une contre-attaque possible : la loi est de ton côté, les outils de détection s’améliorent et la prise de conscience collective monte. Ta meilleure défense ? L’information. Comprendre comment ça marche, c’est déjà désamorcer la peur. Savoir que c’est illégal, c’est reprendre du pouvoir.

Ne laisse jamais personne te faire croire que c’est « juste un mauvais jeu » ou que tu es responsable parce que ta photo était publique. C’est un délit, point barre. Si tu es concerné.e, agis. Si tu connais quelqu’un qui l’est, soutiens-le. Et si tu vois ce contenu circuler, signale-le.

Si tu as été victime ou t’es inquiet pour un proche, n’hésite pas à consulter les ressources de la CNIL ou à contacter un avocat spécialisé. La honte n’est jamais de ton côté : c’est un délit, point barre.